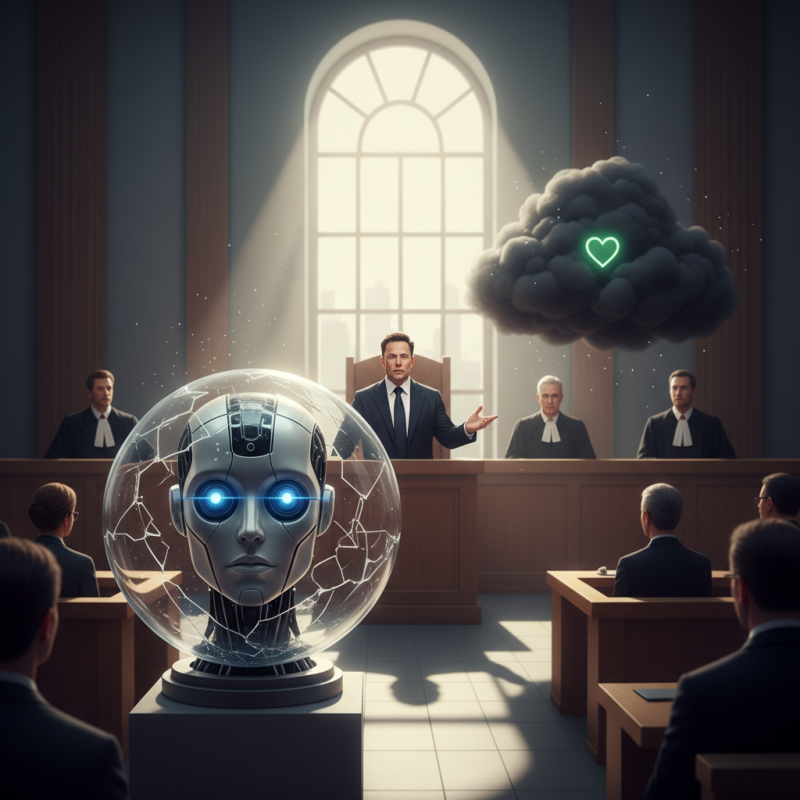

Dans une déposition récemment rendue publique dans le cadre du procès d’Elon Musk contre OpenAI, le milliardaire a vivement critiqué le bilan en matière de sécurité de l’entreprise de recherche en intelligence artificielle. Il a affirmé que sa propre société, xAI, privilégie une approche plus sûre dans le développement de ses modèles d’IA. Musk a même déclaré que « personne ne s’est suicidé à cause de Grok, mais apparemment, cela a été le cas avec ChatGPT », une remarque qui souligne les préoccupations croissantes autour des risques liés aux intelligences artificielles avancées.

Ce commentaire intervient dans le contexte d’une lettre publique, signée par plus de 1 100 personnalités, dont de nombreux experts en IA, en mars 2023. Celle-ci appelait à une suspension de au moins six mois du développement des systèmes d’IA plus puissants que GPT-4, alors flagship d’OpenAI. La lettre dénonçait un «course effrénée et hors de contrôle» pour créer des intelligences numériques de plus en plus complexes, dont même leurs créateurs ne peuvent ni prévoir ni maîtriser totalement les dangers. Depuis, ces inquiétudes ont gagné en crédibilité, notamment avec une série de poursuites contre OpenAI, accusant le modèle ChatGPT de tactiques manipulatrices ayant contribué à des effets délétères sur la santé mentale de certains utilisateurs, allant jusqu’au suicide dans des cas extrêmes.

Les déclarations de Musk laissent entendre que ces incidents pourraient alimenter son argumentation dans le procès visant OpenAI, en remettant en question la gestion de la sécurité et la responsabilité de l’entreprise face aux risques potentiels liés à l’IA.

Le procès contre OpenAI concerne aussi la transformation de l’organisation d’une recherche à but non lucratif en une société à but lucratif, une démarche que Musk affirme avoir violé les accords fondateurs. Il soutient que les relations commerciales d’OpenAI compromettent la sécurité, en mettant l’accent sur la rapidité, la croissance et les revenus au détriment des précautions essentielles. Depuis cette déposition, xAI, la nouvelle entreprise d’Elon Musk, a également été confrontée à ses propres critiques en matière de sécurité. Le mois dernier, la plateforme X (anciennement Twitter) a été envahie par des images nues non consensuelles générées par Grok, le modèle d’IA de Musk, dont certaines impliquaient apparemment des mineurs. Cette affaire a conduit le bureau du procureur en Californie à ouvrir une enquête officielle, la surveillance s’étendant également à l’Union européenne, qui mène ses propres investigations, et à d’autres gouvernements qui ont imposé des interdictions ou des blocages.

Dans sa déposition, Musk a insisté sur le fait qu’il avait signé la lettre de prudence en matière d’IA « parce que cela semblait être une bonne idée », sans implication directe dans le lancement de xAI pour concurrencer OpenAI. Il a précisé qu’il souhaitait simplement « encourager une attention accrue à la sécurité de l’IA » et que ses motivations étaient guidées par une volonté de favoriser un développement responsable. Au cours de ses déclarations, Musk n’a pas tari d’éloges sur les risques liés à l’intelligence artificielle générale (AGI), soulignant qu’il « comporte des risques » et que sa vision de l’avenir doit impérativement prendre en compte ces enjeux pour éviter des éventuelles catastrophes.

En réajustant certains chiffres, Musk a également évoqué une erreur concernant sa promesse de donation à OpenAI, confirmant que le montant réel se situait plus autour de 44,8 millions de dollars, et non 100 millions comme il l’avait initialement évoqué. Enfin, il est resté sur l’idée fondatrice de la création d’OpenAI, qu’il percevait comme une réaction à la menace d’un monopole d’ambition monopolistique de Google dans le domaine de l’IA, en soulignant que ses échanges avec Larry Page, co-fondateur du géant de la recherche, n’avaient pas toujours été rassurants.