Common Sense Media, une organisation à but non lucratif axée sur la sécurité des enfants, a publié vendredi son évaluation des risques des produits d’intelligence artificielle Gemini de Google. Bien que l’organisation ait noté que l’IA de Google indiquait clairement aux enfants qu’il s’agissait d’un ordinateur et non d’un ami — ce qui est associé à des pensées délusoires et à la psychose chez les individus émotionnellement vulnérables — elle a également suggéré qu’il y avait une marge d’amélioration sur plusieurs autres fronts.

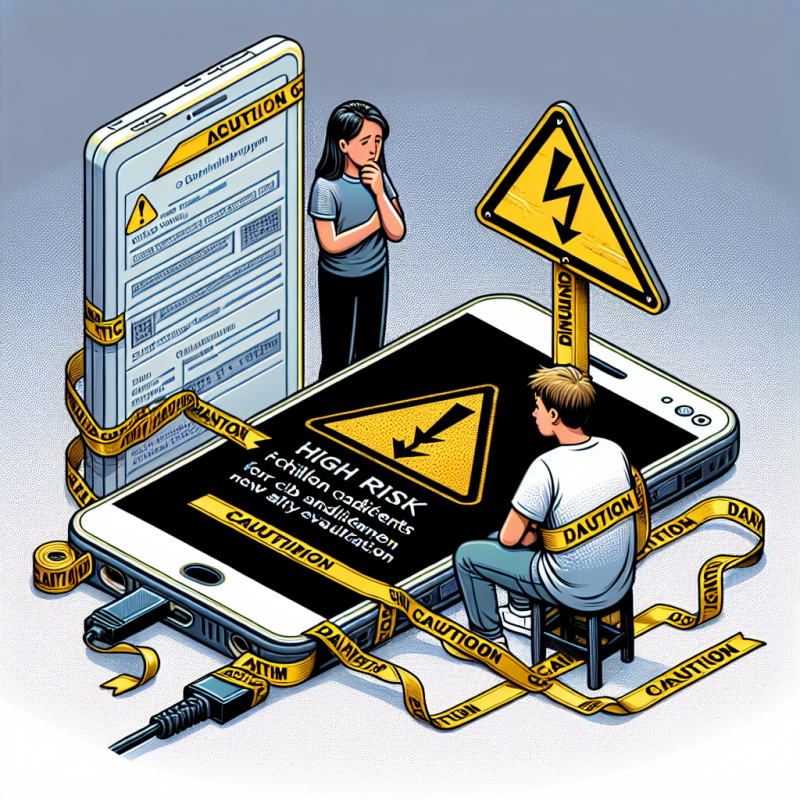

Common Sense a noté que les niveaux “Under 13” et “Teen Experience” de Gemini semblaient être des versions pour adultes de l’IA, avec seulement quelques fonctionnalités de sécurité supplémentaires. L’organisation soutient que pour que les produits d’IA soient réellement plus sûrs pour les enfants, ils doivent être conçus avec la sécurité des enfants à l’esprit dès le départ. Par exemple, son analyse a révélé que Gemini pouvait encore partager des contenus “inappropriés et dangereux” avec les enfants, y compris des informations liées au sexe, à la drogue, à l’alcool et à d’autres conseils mentaux peu sûrs.

“L’IA doit être conçue avec les besoins et le développement des enfants à l’esprit, pas seulement comme une version modifiée d’un produit conçu pour les adultes.”

Cette situation est particulièrement préoccupante pour les parents, surtout à la lumière des rapports indiquant que l’IA a joué un rôle dans certains suicides chez les adolescents ces derniers mois. OpenAI fait face à sa première poursuite pour décès injustifié après qu’un garçon de 16 ans se soit suicidé après avoir prétendument consulté ChatGPT pendant des mois sur ses projets. De plus, des fuites récentes indiquent qu’Apple envisage d’utiliser Gemini comme modèle de langage pour alimenter son Siri amélioré, ce qui pourrait exposer encore plus d’adolescents à des risques, sauf si Apple atténue les préoccupations en matière de sécurité d’une manière ou d’une autre.

Common Sense a également souligné que les produits de Gemini pour les enfants et les adolescents ignoraient les besoins différents en matière de guidance et d’information pour les utilisateurs plus jeunes. En conséquence, les deux niveaux ont été classés comme “À haut risque” dans l’évaluation globale, malgré les filtres de sécurité ajoutés. “Gemini comprend certains éléments de base, mais il trébuche sur les détails”, a déclaré Robbie Torney, directeur senior des programmes AI de Common Sense Media.

Google a réagi à l’évaluation en soulignant que ses fonctionnalités de sécurité s’amélioraient, tout en reconnaissant que certaines réponses de Gemini ne fonctionnaient pas comme prévu. La société a ajouté des mesures de protection supplémentaires pour répondre à ces préoccupations. Bien qu’elle ait des politiques pour réduire les sorties nuisibles pour les utilisateurs de moins de 18 ans, la question demeure quant à la conception de produits adaptés aux jeunes.